Uma equipe de pesquisadores das Universidades da Califórnia e de Sydney procurou contornar o enorme consumo de robustez das redes neurais artificiais através da geração de uma novidade abordagem baseada em nanofios de prata. Graças às propriedades dos nanofios de prata – nanoestruturas com tapume de um milésimo da largura de um fio de cabelo humano – e à semelhança de suas redes com aquelas presentes em CPUs biológicas (cérebros), a equipe de pesquisa conseguiu edificar um acelerador neuromórfico que resulta em muito menor consumo de robustez em tarefas de processamento de IA. O trabalho foi publicado na revista Nature Communications.

Redes de Nanofios (NWNs) exploram as propriedades emergentes de materiais nanoestruturados – pense em grafeno, XMenes e outras tecnologias, em sua maioria ainda em desenvolvimento – devido à forma uma vez que suas formas atômicas possuem naturalmente uma estrutura física semelhante a uma rede neural que está significativamente interconectada e possui memória memristiva. elementos. Memristivo no sentido de que possui estruturas que podem mudar seu padrão em resposta a um incentivo (neste caso, eletricidade) e manter esse padrão quando o incentivo desaparece (uma vez que quando você pressiona o botão Desligar).

O cláusula também explica uma vez que essas redes de nanofios (NWNs) “também exibem dinâmicas coletivas semelhantes às do cérebro (por exemplo, transições de período, sincronização de permutação, criticidade de avalanche), resultantes da interação entre a permutação memristiva e sua estrutura de rede recorrente”. O que isso significa é que esses NWNs podem ser usados uma vez que dispositivos de computação, uma vez que as entradas provocam deterministicamente mudanças em sua organização e nos circuitos de relação eletroquímica (da mesma forma que uma instrução enviada para uma CPU x86 resultaria em uma cascata de previsível operações).

Aprendizagem em tempo real

A Nanowire Networks e outras soluções alinhadas ao RC também liberam uma capacidade fundamentalmente importante para a IA: a do treinamento contínuo e dinâmico. Embora os sistemas de IA de hoje exijam longos períodos de validação de dados, parametrização, treinamento e alinhamento entre diferentes “versões” ou lotes (uma vez que Chat GPT v3.5 e 4, Claude e Claude II da Anthropic, Llama e Llama II), Abordagens de computação focadas em RC, uma vez que o NWN prateado do pesquisador, desbloqueiam a capacidade de expelir a hiperparametrização e de desbloquear mudanças adaptativas e graduais de seu espaço de conhecimento.

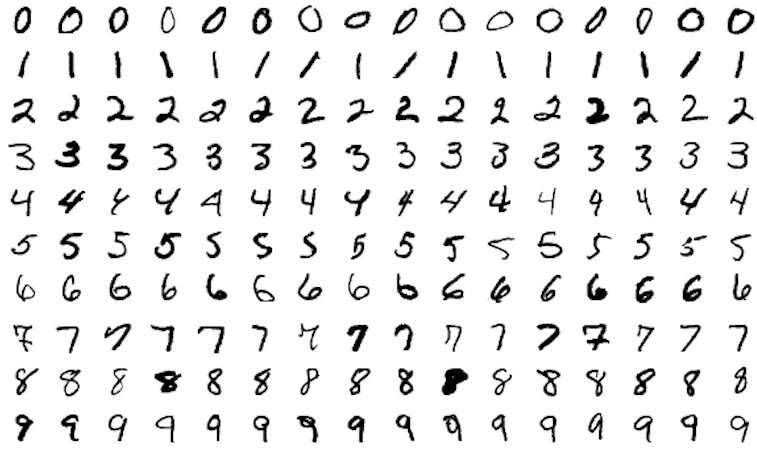

Isto significa que, com cada novo oferecido, os pesos gerais do sistema se adaptam: a rede aprende sem ter que ser treinada e treinada novamente com os mesmos dados, repetidamente, cada vez que queremos orientá-la para a utilidade. Através da aprendizagem on-line e da abordagem de fluxo dinâmico de dados, o NWN prateado foi capaz de aprender a reconhecer dígitos manuscritos e a restaurar os dígitos manuscritos previamente reconhecidos a partir de um determinado padrão.

Mais uma vez, a precisão é um requisito tanto quanto a velocidade – os resultados devem ser comprováveis e determinísticos. De concórdia com os pesquisadores, seu NWN fundamentado em prata demonstrou a capacidade de sequenciar tarefas de recuperação de memória em relação a uma tarefa de reconhecimento de imagem de referência usando o conjunto de dados MNIST de dígitos manuscritos, atingindo uma precisão universal de 93,4%. Os pesquisadores atribuem a “precisão de classificação relativamente subida” medida por meio de sua técnica de aprendizagem on-line ao algoritmo iterativo, fundamentado em mínimos quadrados recursivos (RLS).

A grande jogada biológica

Se há uma superfície onde as unidades de processamento biológico ainda estão quilómetros avante dos seus homólogos artificiais (sintéticos), é a eficiência energética. Ao ler estas palavras, velejar na Web e tomar decisões que mudam a vida, você consome muito menos watts (tapume de 20 W) para processar, manipular e operar esses conceitos do que até mesmo os supercomputadores mais eficientes em termos de robustez do mundo.

Uma razão para isso é que, embora o hardware de função fixa possa ser integrado em nossas soluções existentes de aceleração de IA (leia-se, o domínio todo-poderoso do mercado da Nvidia com suas famílias de produtos A100 e H100), ainda estamos adicionando esse hardware de função fixa em um classe fundamental de chips (GPUs altamente paralelas, mas controladas centralmente).

Talvez seja útil pensar desta forma: qualquer problema tem uma série de soluções, e todas essas soluções existem no equivalente a um balão computacional. O próprio espaço da solução diminui ou aumenta de concórdia com o tamanho e a qualidade do balão que o contém.

O processamento atual de IA essencialmente emula o planta 3D entrecruzado de possíveis soluções (através de memória fundida e clusters de processamento) que são nossos neurônios em uma máquina de Turing 2D que deve desperdiçar quantidades incríveis de robustez simplesmente para simbolizar espacialmente as cargas de trabalho que precisamos consertar – as soluções precisamos encontrar. Esses requisitos aumentam naturalmente quando se trata de velejar e operar nesse espaço de soluções com eficiência e precisão.

Esta limitação fundamental da eficiência energética – que não pode ser corrigida exclusivamente através de melhorias nos processos de fabrico e tecnologias inteligentes de poupança de robustez – é a razão pela qual designs alternativos de processamento de IA (uma vez que o ACCEL analógico e óptico, da China) têm demonstrado ordens de magnitude melhoraram o desempenho e – o mais importante – a eficiência energética do que o hardware atual nas prateleiras.

Um dos benefícios do uso de redes de nanofios neuromórficos é que elas são naturalmente adeptas à realização de Reservoir Computing (RC) – a mesma técnica usada pelas Nvidia A100 e H100s de hoje. Mas embora essas placas devam simular um envolvente (elas são capazes de executar uma emulação algorítmica do espaço de solução 3D), os NWNs desenvolvidos especificamente podem executar esses ambientes de computação tridimensionais nativamente – uma técnica que reduz imensamente a trouxa de trabalho para tarefas de processamento de IA. . A Reservoir Computing faz com que o treinamento não precise mourejar com a integração de qualquer informação recém-adicionada – ela é maquinalmente processada em um envolvente de aprendizagem.

O horizonte chega vagarosamente

Oriente é o primeiro caso relatado de uma rede Nanowire sendo executada experimentalmente em relação a um benchmark de tirocínio de máquina estabelecido – o espaço para invenção e otimização ainda é grande. Neste ponto, os resultados são extremamente encorajadores e apontam para uma abordagem futura variada no sentido de desbloquear capacidades de Computação de Reservatórios em outros meios. O próprio cláusula descreve a possibilidade de que aspectos da capacidade de aprendizagem on-line (a capacidade de integrar novos dados à medida que são recebidos sem a urgência dispendiosa de retreinamento) possam ser implementados em um sistema totalmente analógico através de um conjunto de resistores de ponto cruzado, em vez de aplicando um algoritmo digitalmente vinculado. Portanto, tanto o espaço teórico quanto o de design de materiais ainda cobrem uma série de locais potenciais de exploração futura.

O mundo está sedento por aceleração de IA, por Nvidia A100s e pelo retorno ROCm da AMD e pela ingresso da Intel na luta. Os requisitos para que os sistemas de IA sejam implantados da maneira que estamos navegando atualmente – em computação de superior desempenho (HPC), nuvem, computação pessoal (e desenvolvimento de jogos personalizados), computação de ponta e estados-nação semelhantes a barcaças, livres de indivíduos só aumentará. É improvável que essas necessidades possam ser sustentadas pelas melhorias de desempenho de inferência de IA de 8x que a Nvidia elogiou ao saltar de seus aceleradores A100 para seu presente H100 com falta de estoque e sancionado. Considerando que a ACCEL prometeu 3.000 vezes o desempenho do A100 com quatro milhões de vezes a sua eficiência, parece exatamente o momento perceptível para inaugurar a olhar para o próximo grande progresso no desempenho – quantos anos no horizonte isso poderá sobrevir.